Seminario in Vaticano sull'IA. Tighe: la Chiesa sostiene lo sviluppo di sistemi etici

Edoardo Giribaldi – Città del Vaticano

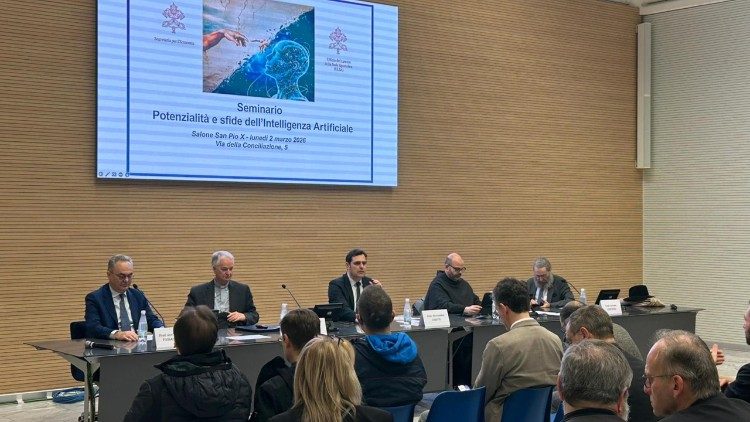

“Un’abbondanza di mezzi e una confusione di fini”. La formula attribuita ad Albert Einstein è istantanea di un mondo interpellato dalle nuove tecnologie e da esse plasmato. Gli interessi in gioco sono molteplici, non “neutrali”, ed è in tale contesto che la Santa Sede, priva di fini militari o commerciali, può svolgere un ruolo chiave nella promozione di una governance globale che sviluppi sistemi “etici fin dalla loro progettazione”. Sono stati questi alcuni degli spunti emersi dal seminario Potenzialità e sfide dell’Intelligenza Artificiale organizzato dalla Segreteria per l’Economia e dall’Ufficio del Lavoro della Sede Apostolica (ULSA), tenutosi questa mattina, 2 marzo, presso il Salone San Pio X di Via della Conciliazione, 5, a Roma. I lavori sono stati aperti dal professor Pasquale Passalacqua, direttore dell’ULSA, che ha evidenziato come Papa Leone XIV stesso, informato direttamente circa l’iniziativa dal presidente, mons. Marco Sprizzi, l’abbia “apprezzata e incoraggiata”, auspicando una “più profonda consapevolezza in questo ambito così "attuale e complesso". Gli interventi sono stati moderati da Alessandro Gisotti, vice direttore editoriale del Dicastero per la Comunicazione. I relatori sono stati monsignor Paul Tighe, segretario del Dicastero per la Cultura e l'Educazione; padre Paolo Benanti, docente presso la Pontificia Università Gregoriana e l’Università LUISS Guido Carli; e il professor Corrado Giustozzi, docente presso il corso di laurea magistrale in Ingegneria dei Sistemi Intelligenti dell'Università Campus Bio-Medico.

Volatilità, incertezza, complessità, ambiguità

Per sintetizzare le conseguenze seguite alla diffusione, nel 2022, di ChatGPT, uno dei chatbot più popolari sviluppato dall’azienda statunitense OpenAI, monsignor Tighe ha utilizzato l’acronimo VUCA: Volatility (Volatilità), Uncertainty (Incertezza), Complexity (Complessità) e Ambiguity (Ambiguità). I rischi, “senza cedere a retoriche apocalittiche”, sono tuttavia concreti: “Armi biologiche, propaganda, disinformazione, sistemi che sfuggono al controllo umano”. Rappresentatività, trasparenza e comprensibilità sono parole chiave per contrastare il “paradigma tecnocratico” già individuato da Papa Francesco, che rischia di amplificare ingiustizie, disuguaglianze, polarizzazione e minacce ambientali anziché sanarle. Lo sviluppo dell’IA non avviene, dunque, in spazi neutrali, ha ribadito il vescovo irlandese. In mancanza di regolamentazioni internazionali, “le grandi potenze puntano alla superiorità tecnologica, soprattutto in ambito militare”, mentre “la consapevolezza di una possibile bolla finanziaria incentiva l’assunzione di rischi a scapito della sicurezza”. In tal senso, monsignor Tighe ha citato la cronaca recente e il caso di Anthropic, azienda statunitense nata con l’obiettivo di sviluppare un’IA più etica e oggetto di “pressioni governative per allentare i propri impegni etici sugli usi militari e di sorveglianza”.

I rischi sociali delle nuove tecnologie

I modelli di Intelligenza Artificiale, inoltre, sono progettati per assecondare l’utente, spesso dalle stesse aziende che controllano i social media, fino al punto di "adulare" l'utente e generare “allucinazioni”, fornendo “risposte attese più che accurate”. È stato inoltre evidenziato il rischio di delegare all’IA mansioni cognitive propriamente umane, specialmente da parte di chi non è in grado di valutarne criticamente i risultati e di porre le domande adeguate. Non ne risentono soltanto gli ambiti lavorativi e accademici, ma anche quelli personali, relazionali e spirituali, incarnando l’osservazione dello psicologo Abraham Maslow: “Per chi ha un martello, tutto sembra un chiodo”.

La Chiesa orienti lo sviluppo dell’IA

Di fronte a tali complessità, il vescovo ha richiamato il documento Antiqua et Nova indicando nella “sapienza del cuore, capace di integrare il tutto e le parti”, ciò di cui l’umanità ha oggi più bisogno: un’intelligenza che, di fronte alla potenza degli strumenti a disposizione, si interroghi sul loro servizio, sui loro fini e sulle loro conseguenze. In questo quadro si comprende “l’attenzione suscitata dall’impegno di Papa Leone XIV nel porre la riflessione sull’intelligenza artificiale tra le priorità del suo pontificato”. Dal canto suo, la Chiesa possiede un’“autorità morale” e la capacità di riunire interlocutori qualificati, diventando un partner significativo nell’orientare lo sviluppo dell’IA.

La conoscenza, dono e non dato

Monsignor Tighe ha spiegato, punto per punto, come tali principi possano tradursi in azione concreta da parte della Chiesa. Sul fronte della competitività, promuovendo cooperazione e governance globale delle nuove tecnologie. Nel contesto della polarizzazione, riaffermando la cultura dell’incontro e del dialogo. In relazione alle disuguaglianze, ricordando che “un patto sociale realistico” deve tenere insieme anche le diverse culture e visioni del mondo. Infine, sul fronte della “delega cognitiva”, ribadendo la visione cattolica dell’educazione e rafforzando la rete delle università cattoliche.

Le sfide etiche dell'IA

La relazione di padre Benanti si è focalizzata sulle sfide etiche dell’intelligenza artificiale, proponendo una visione che interroghi la "politica" di tali modelli. “Ogni artefatto tecnologico quando impatta un contesto sociale funziona come disposizione di potere e forma d’ordine”, ha affermato il francescano, sottolineando l'urgenza di una questione che risuona in “diversi tavoli”: dalla Santa Sede, alle Nazioni Unite – padre Benanti è membro del Comitato ONU sull'IA – dove le citate “disposizioni di potere” sono sempre più influenzate da "accordi commerciali".

I diversi scopi della tecnologia

Ciò si riverbera anche nel contesto dell’informazione: la visibilità di un articolo non dipende necessariamente dalla sua qualità, ma ormai maggiormente dalla posizione che l’algoritmo gli concede sulle pagine web. Una “mediazione di potere”, ha sostenuto il docente. L’innovazione può essere dettata da uno “special purpose”, quando nasce in risposta a una necessità, seppur “mai neutrale”. Ma esistono anche famiglie di tecnologie che “di per sé non cambiano niente, ma modificano il modo di fare le cose”. Le cosiddette “general purpose technologies”, come l’elettricità e la stessa IA. “Per questo è un tema così importante: perché attraverso l’IA abbiamo cambiato la natura degli oggetti che creano la realtà". Una cosiddetta "software defined society", una società definita dai software che utilizza, che tocca la natura e i processi decisionali di qualsiasi organizzazione, compresa la Santa Sede.

Togliere "attrito", cedere potere

Il vantaggio nell'utilizzo dell'IA, ha affermato padre Benanti, sta nel togliere "attrito". Una metafora che trova svariate concrete applicazioni. Ad esempio, una app per incontri toglie l'attrito, la "fatica" di cercare l'amore della propria vita. "Ma così facendo, si cede una parte del proprio potere" e l’informazione passata diventa così “strumento di controllo”. In tal senso, a conclusione di intervento, il vice direttore editoriale del Dicastero per la Comunicazione ha richiamato il messaggio di Papa Leone XIV per la 60.ma Giornata Mondiale delle Comunicazioni Sociali, e un'auspicata "l’alfabetizzazione ai media, all’informazione e all’IA".

Cosa è un algoritmo

L’intervento del professor Giustozzi si è concentrato sulla natura dell’IA e sui suoi limiti tecnici, presentando uno dei suoi componenti essenziali: l’algoritmo e le principali criticità dei processi decisionali basati su algoritmi. Tra queste, il problema del bias: gli algoritmi possono attuare meccanicamente “strategie di scelta che sono nella mente del loro ideatore”, incorporando talvolta pregiudizi, in buona fede o deliberati, che falsano i risultati o li rendono iniqui". Un algoritmo, inoltre, può risultare inefficace se il problema è formulato in modo scorretto; può produrre esiti distorti se fondato su assunzioni imprecise o su approssimazioni eccessivamente semplificative.

L’importanza del training dell’IA

Approfondendo ulteriormente la questione, il professor Giustozzi ha spiegato l'importanza decisivo del training, ossia la fase di addestramento, nello sviluppo dell’algoritmo: se i dati sono incompleti o distorti, i risultati saranno inevitabilmente errati o discriminatori. Una natura complessa e intricata, al punto che per inquadrarla, il docente ha riadattato un celebre aforisma di sant'Agostino relativo al tempo: "Se nessuno me ne chiede, lo so bene: ma se volessi darne spiegazione a chi me ne chiede, non lo so". Il professore ha infine richiamato l’attenzione sui rischi connessi all’uso dell’IA, sottolineando che essa deve essere sempre considerata un “supporto” all’attività umana e che i suoi risultati devono essere oggetto di una costante revisione critica. Facendo riferimento al concetto del training e della collezione di dati, Gisotti ha fatto notare come l'impatto dell'IA influisca anche sull'ambiente e la casa comune: in Virginia, negli Stati Uniti, oltre il 30% dell'energia viene utilizzata dai cosiddetti datacenter, i centri che immagazzinano le informazioni su cui poi si baserà l'addestramento delle nuove tecnologie. In Irlanda, il dato rimane ugualmente significativo: il 20% utilizzato da Google. Una realtà, in sintesi, assai "energivora". Nella parte finale del seminario i partecipanti hanno rivolto quesiti di approfondimento ai relatori.

Grazie per aver letto questo articolo. Se vuoi restare aggiornato ti invitiamo a iscriverti alla newsletter cliccando qui